有图未必是真相 AI技术如何编造谣言及网络信息安全软件的应对之道

在信息爆炸的今天,图像和视频已成为网络传播的主流形式。随着人工智能(AI)技术的飞速发展,有图未必是真相——AI工具能够轻易生成、修改图像和视频,甚至编造出看似真实的谣言,对个人隐私、社会稳定构成威胁。本文将探讨AI技术如何被滥用于编造虚假信息,并介绍网络与信息安全软件如何应对这一挑战。

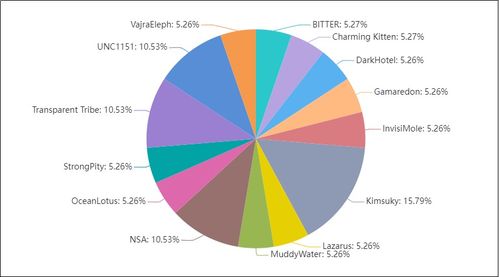

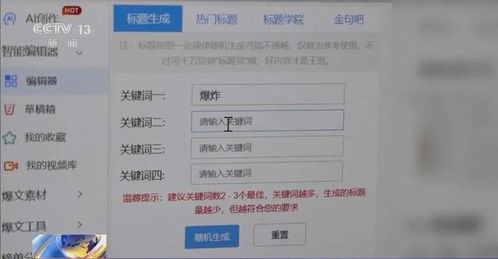

AI技术如何助力谣言制造?以深度伪造(Deepfake)为例,这项技术利用生成对抗网络(GAN)等算法,可将一个人的面部表情、声音无缝替换到另一段视频中,制造出名人发表不当言论或普通人参与虚假事件的影像。AI图像生成工具(如DALL·E或Stable Diffusion)能凭空创造出逼真的图片,例如虚假灾难现场或政治事件,再配以误导性文字,迅速在社交媒体扩散。这些技术降低了造谣门槛,使得普通用户也能快速生产“证据”,加剧了信息混乱。

AI编造的谣言危害深远。一方面,它可能侵犯个人权益,如利用伪造图像进行诽谤或诈骗;另一方面,它可能扰乱公共秩序,例如在选举期间散布虚假信息,影响舆论导向。根据研究,AI生成的虚假内容传播速度是真实信息的6倍,且难以被普通用户识别,这凸显了网络信息安全的紧迫性。

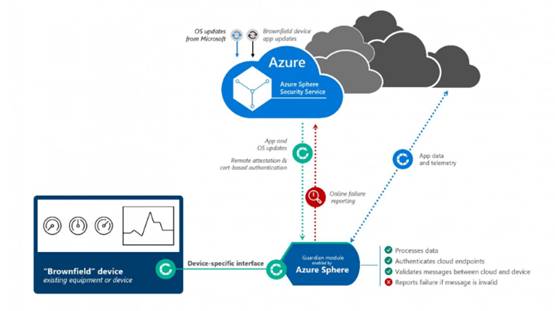

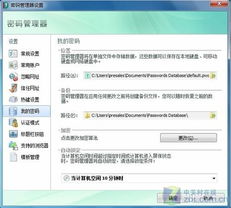

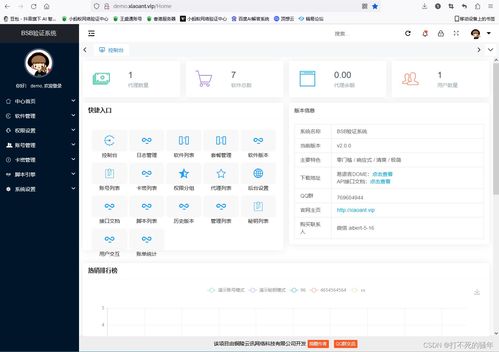

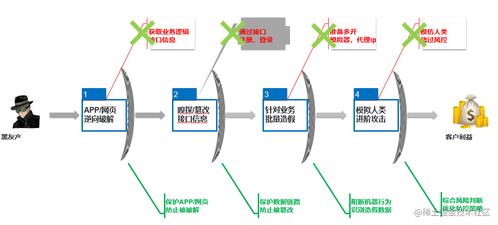

面对这一挑战,网络与信息安全软件的开发显得至关重要。当前,业界已推出多种工具来检测和防范AI生成的虚假内容。例如,基于AI的反伪造软件使用机器学习模型分析图像和视频的元数据、像素级特征,识别出深度伪造的痕迹;区块链技术则被用于验证媒体来源,确保信息的真实性。安全软件还集成实时监控和警报功能,帮助用户过滤可疑内容,并提供教育性提示,提升公众的数字素养。

随着AI技术的演进,网络与信息安全软件需不断创新。开发者应加强跨领域合作,整合计算机视觉、自然语言处理等技术,提高检测准确率;推动立法和行业标准,确保AI应用的伦理边界。普通用户也应保持警惕,不轻信未经核实的信息,并积极使用安全工具保护自己。

AI技术是一把双刃剑,它在推动社会进步的也为谣言制造提供了新工具。通过加强网络与信息安全软件的研发和应用,我们可以更有效地揭开虚假真相,维护清朗的网络空间。记住:在数字时代,批判性思维和安全软件是我们的第一道防线。

如若转载,请注明出处:http://www.drylauv.com/product/28.html

更新时间:2026-05-29 21:20:07